Hören, beurteilen, mixen

Vor einigen Jahren hatte unser Autor Thilo Goldschmitz den folgenden vierteiligen Recording-Workshop für AMAZONA.de verfasst. Mit einigen Updates versehen, möchten wir euch diesen nicht vorenthalten. Während es im ersten Teil des Workshops um die Grundlagen unseres Hörens, Lautstärken und Frequenzen geht, widmen wir uns in den nächsten Teilen dem eigentlichen Vorgehen beim Mix, der Nutzung von Subgruppen und wir gehen auf die Räumlichkeit des Mixes ein. Der Recording-Workshop ist dabei gleichermaßen für das reine analoge Mischen wie auch für all diejenigen interessant, die „in the box“ arbeiten.

Viele Instrumente verderben den Mix

Wer kennt das nicht – da hat man sein Stück fertig komponiert, alle Spuren minuziös aufgenommen, und weiß, dass jede Spur für sich gut klingt – und dann … klingt alles zusammen so, wie Fish’n’Chips schmeckt. Es passt überhaupt nichts zusammen, der Bass wummert, dröhnt und überdeckt die Bassdrum, die Gitarre scheint im Synthesizer-Pad abzusaufen und die Vocals hören sich an, als kämen sie aus der Schrottpresse. Kurz – der Gesamtmix wabert und blubbert und klingt irgendwie nur nach Matsch. Jedes Instrument für sich klang gut aufgenommen, wie kann es sein, dass dann der Gesamtmix zu matschig klingt? Was ist da passiert?

Das Gehör, ein kurzer (theoretischer) Ausflug

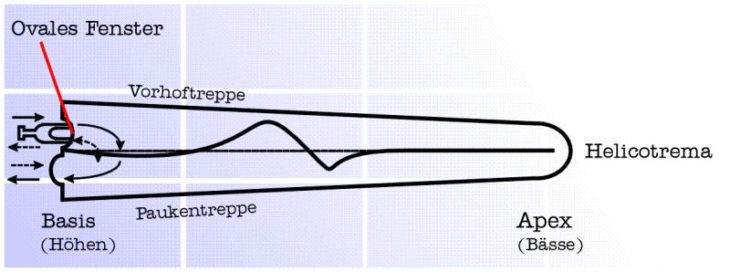

Um die hier besprochenen Zusammenhänge etwas mit Hintergrundwissen zu ergänzen, ist es nützlich, sich einmal mit der Art und Weise zu beschäftigen, WIE wir eigentlich hören. Das eigentliche Hörorgan ist das Innenohr. Hier befindet sich die sogenannte Schnecke, in der die Basilarmembran aufgerollt ist. Trifft Schall auf dem Trommelfell auf und wird von den Ohrknöchelchen übertragen, ergeben sich Schwingungen auf dieser Basilarmembran. Dadurch werden die Härchen der Nervenzellen bewegt. Diese werden dann von den Nervenzellen als elektrische Impulse an das Gehirn weitergeleitet. Abb. 1 zeigt die Basilarmembran, entrollt. Hier ist auch zu sehen, welche Bereiche für welche Frequenzen zuständig sind.

Die Wahrnehmung der Frequenz (Tonhöhe) ist dabei in verschiedene Frequenzbänder aufgeteilt. Diese sind gleichmäßig über die Basilarmembran verteilt. Diese Frequenzbänder haben für unterschiedliche Tonhöhen auch unterschiedliche Bandbreiten. Eine Faustregel besagt, dass bis zu Frequenzen von 500 Hz die Bänder eine Breite von 100 Hz haben, danach eine Breite von 20 %, bezogen auf die ausgewählte Frequenz (also 200 Hz Bandbreite bei 1.000 Hz). Dieses Wissen ist nützlich, um die Prinzipien des Abmischens begreifen zu können. Zurück zu unserem englischen Nationalgericht.

Vereinheitlichung der Lautstärkeverhältnisse

Das erste Problem ist die Verteilung der Lautstärkeverhältnisse im Mix. Dazu geht man am besten zunächst einmal stur nach Schema ‚F‘ vor. Damit schafft man sich eine einheitliche Basis für die Weiterverarbeitung des Mixes und dazu noch eine einheitliche Grundlage in der Vorgehensweise. Zunächst stellt man jede eventuell vorhandene Equalizer-Einstellung auf null. Dann stellt man jeden Kanal auf etwa den gleichen Pegel ein. Dazu benutzt man entweder die Solo-Funktion des Mischpults oder schaltet alle anderen Kanäle stumm. Dann kann man an den Gain-Anzeigen ablesen, um welchen Mittelwert ein Instrument pegelt. Gemeint ist also nicht der maximale Ausschlag, sondern der Wert, der praktisch ständig erreicht wird, wenn das Instrument (oder die Spur) zu hören ist. Diesen Mittelwert merkt man sich und stellt alle anderen Instrumente auf eben diesen Mittelwert ein. Als nächstes regelt man all die Instrumente, die offensichtlich zu laut sind leiser. Das soll der Ausgangspunkt sein.

Überdeckung von Frequenzen/Tönen

Eine typische Eigenschaft des Gehörs ist es, dass bestimmte Töne (oder Frequenzen) andere, ähnliche Töne überdecken. Das gilt für die Lautstärke sowie für die Frequenz. Ein häufiges Problem im Mixdown ist es, eine klar strukturierte Staffelung der Instrumente zu erreichen. Die Gitarre haut mit in den Bass-Bereich, der Bass wiederum dringt mit seinen Höhenanteilen in die Synthesizer-Fläche ein und macht diese dadurch unruhig.

Man sollte sich also generell überlegen, welchen Part eigentlich jedes Instrument spielt (ein Bass kann ja auch durchaus als solierendes Instrument gebraucht werden). Dann sollte man ganz grob damit beginnen, Instrumente, bei denen klar ist, dass sie nicht die Rolle des Basses spielen, im Frequenzbereich ‚Bass‘ abzusenken. Die meisten Mischpulte haben dafür einen Low-Cut-Schalter, der ab einer Frequenz von 75~80 Hz alle Bassfrequenzen drastisch absenkt. Ebenso sollte man für allzu aufdringliche „Höhen“-flüge des Basses dafür sorgen, dass dessen Frequenzen ab ~9.000 Hz eine Absenkung erfahren. (Dafür gibt es zwar keinen Hi-Cut Schalter, aber Equalizer.) Problematisch wird die Staffelung des Mixdowns jedoch erst, wenn Instrumente einen ähnlichen Frequenzbereich belegen.

Frequenzanteile im Gesamtmix

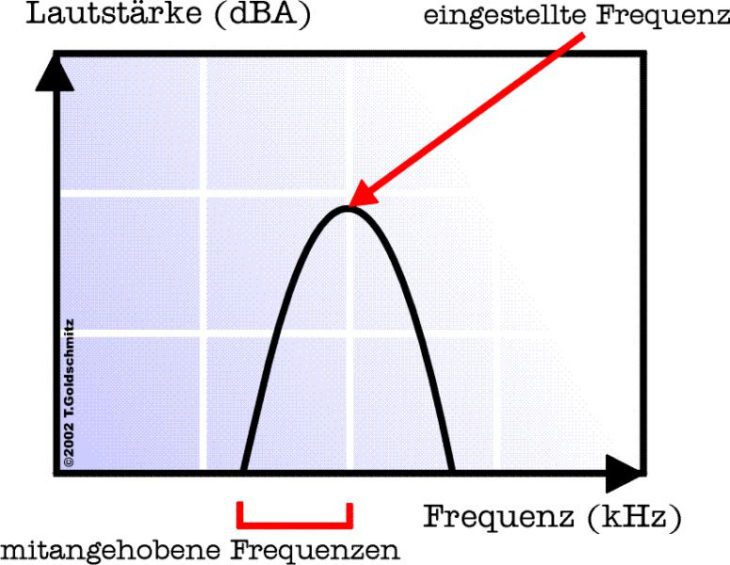

Doch was macht einen Mix matschig? Man stellt sich Frequenzen des hörbaren Frequenzspektrums als Energieanteile dieses Spektrums vor. Haben zwei Instrumente eine ähnliche Frequenzverteilung, kommen sie sich im Mix gegenseitig in die Quere (die Schwingungen befinden sich in örtlicher Nähe auf der Basilarmembran). Meistens ist man daran auch noch selber Schuld. Man hat zuvor jede Spur abgehört und mit den EQs so eingestellt, dass sie möglichst laut und präsent erscheinen. Ein häufig begangenes Missverständnis dabei ist jedoch, immer nur Frequenzanteile anzuheben. Das mag zwar im Solo-Mode ordentlich klingen, schafft aber Probleme im Mixdown. Zieht man nämlich die Frequenzen immer nur hoch, muss man sich folgendem bewusst sein: Beeinflusst wird nicht nur die Frequenz, die man hochdreht. Angrenzende Frequenzen werden ebenso angehoben, wenn auch in geringerem Maße. Abb. 2 veranschaulicht das.

Dieser Umstand ist technikbedingt und ist analog nicht anders zu lösen (tatsächlich gibt es digitale Filter, die nur eine exakt bestimmte Frequenz beeinflussen, diese klingen aber zu harsch und gar nicht angenehm für unser Ohr). Jetzt wird auch klar, was passiert, wenn man den Gain-Regler immer nur nach oben schraubt. Selbst wenn die Anhebung bei Instrument 1 in einem auch nur ähnlichen Frequenzbereich geschieht wie bei Instrument 2, wird der Gesamtanteil dieser Frequenz im Mix überbetont. Bis zu einem gewissen Grad ist das noch nicht sehr schlimm. Man stelle sich jedoch jetzt mal ein paar mehr Instrumente und Spuren vor …

Weniger ist mehr

Wie kann dem also Abhilfe geschaffen werden? Die fehlerhafte Annahme ist, man beeinflusse mit dem Equalizing nur das „equalizte“ Instrument. Wie wir gesehen haben, stimmt das so nicht. Der Trick ist zunächst nicht mehr, sondern weniger Gain auf die Frequenzen des Instruments zu geben. Man hebt also nicht die Anteile hervor, die man lauter haben möchte, sondern senkt die Frequenzen AB, die man dem Instrument nicht geben möchte.

Das scheint im ersten Moment etwas verwirrend, wird jedoch verständlich, stellt man sich den Gesamtmix vor. Man beeinflusst jetzt also ein anderes Instrument, dessen Frequenzanteile in einem ähnlichen Bereich liegen, nicht mehr negativ (d. h. verdeckt es), sondern positiv (man hebt es zusätzlich hervor). Damit kann man sich sogar oft Arbeit sparen, da mit einer Klappe gleich mehrere Fliegen geschlagen werden können.

Ein (im Frequenzspektrum) benachbartes Instrument wird jetzt also durch frei werdende „Luft“ im Gesamtmix hervorgehoben. Das bedeutet dann also, dass die Gain-Anhebung für eben dieses Instrument (wenn gewünscht), auch nicht mehr erforderlich ist. Wird jedes Instrument nach der „less gain“ Methode im Mix bearbeitet, schafft man sich damit eine Menge Platz (nicht belegte Anteile) im Frequenzspektrum.

Das hörbare Ergebnis ist damit also: Der Mix klingt zwar insgesamt etwas leiser, ist jedoch im Gegensatz vorher differenzierter, klarer und offener. Um unser Wissen um die Basilarmembran noch einmal zu nutzen: Es ist uns damit also gelungen, die Auslenkung gleichmäßig und physiologisch angenehm über die Membran zu verteilen. Vorher jedoch waren Bereiche überbetont. Diese Bereiche beeinflussen wiederum angrenzende Frequenzbereiche und verdecken somit Signale in diesen. Ergebnis hier: Der Mix matscht zu. Zur Kompensation der geringeren Lautstärke ist es nur noch erforderlich, den Maste- Gain aufzudrehen. Hier bietet sich nun wieder die Möglichkeit, durch Rücknahme der Gain-Absenkung (also Gain-Anhebung), einzelne Instrumente noch etwas hervorzuheben, ohne Gefahr zu laufen, den Mix wieder matschig werden zu lassen.

Die Spitze des Eisbergs

Die hier dargestellte Methode soll als Hilfestellung dienen, Ordnung in den Mix zu bekommen. Keinesfalls soll hier der Eindruck entstehen, es sei „verboten“, im Equalizing den Gain einer Frequenz auch mal nach oben zu drehen. Dies kann insbesondere bei Lead-Stimmen, sei es Vocal, Synthesizer oder Gitarre, sehr von Vorteil sein.

Generell ist es aber ökonomischer, aus den genannten physiologischen Gründen, die gesamte Frequenzbandbreite auszunutzen. Das schafft Übersicht und ein angenehmes Hörerlebnis. Die Kunst des Abmischens ist tiefgründig und vielfältig und jeder hat sein etwas anderes Rezept, seinen Mix klar zu kriegen. Im weiteren Verlauf der Serie soll auf Dinge des Mischer-Alltags (Kompressoren – wofür?) eingegangen, gleichzeitig aber auch Ausflüge in kreative Gefilde (Patchbay – flexibel und kreativ) z. B. mit extrem FXing gemacht werden. Alle hier gemachten Vorschläge können natürlich auch auf digitale Mischsituationen übertragen werden. Diese bilden ja im Grunde nur die analoge Wirklichkeit ab.

Im zweiten Teil unseres Workshops geht es darum, wie man die Subgruppen (auch Busse genannt) einsetzt, um Übersicht auf der Mischoberfläche zu schaffen. Diesen findet ihr hier.

Guter Artikel!!!

Ich freue mich schon auf den Nächsten!!!

Ich hab mal gehört, man soll eher digital absenken ( in der DAW) und analog anheben (mit Outboard)…

weil analoge Geräte das schöner hinbekommen, ist da was dran???

@D-Joe Kann man nicht so pauschalisieren, aber eins ist klar: Digitales Clipping ist unschöner, schon bei leichter Übersteuerung als das analoge Soft Clipping.

Problematisch isses also nur in Sachen Übersteuerung, nicht generell.

@D-Joe @D-Joe: Könnte mir durchaus vorstellen das dies je nach persönlicher Erwartungshaltung und Hörgewohnheit Sinn macht. Aber auf der anderen Seite geht das auch schon meiner Ansicht nach in Richtung „Musik-Esoterik“. Wenn man sich mit solchen Fragen beschäftigt, dann bedeutet dies, dass die Arrangements absolut perfekt sind. Die Sounds ebenso wie das ganze Studio inkl. Monitoring Top-High-End sind. Oftmals klemmt es meiner Meinung nach ganz wo anders, bevor man sich über solche Fragen Gedanken macht.

Hi,

sehr guter Artikel!

Ein Thema das häufig übersehen wird ist Gain-Staging. Gerade wenn man in-the-box arbeitet. Ich war vor Jahren auch noch der Meinung jeden Track bei der Aufnahme nahe O dBFS bringen zu müssen. Das überfordert ne DAW bzw. PlugIns komplett. Jetzt liegt mein Arbeitspegel in den Spuren bei -12 bis -18 dB und siehe da: Mixes werden viel leichter zu händeln.

Nichtsdestotrotz: Die im Artikel beschriebenen Themen sind toll erklärt. Daumen hoch dafür. Freue mich auf den zweiten Teil und ff.

Gr

Sehr feiner Artikel. Bitte mehr!

Toller Artikel, den Ihr dort auf die Beine gestellt habt. Die Hörphysiologie als Basis für die Schallrezeption sollte bekannt sein. Wichtiger für den Mix sind allerdings die Parameter wie Richtungshören, Verdeckungseffekte , frequenzabhängige Lokation und vieles mehr, für das Ihr hier einen guten Ansatz liefert. Toll.

Ich werde Euren Artikel auf die Facebook Seite vom Portal http://www.StageAID.de verlinken, weil er sicher auch für andere Musiker interessant ist.

Dankeschön! Guter Beitrag. Sogar eine neue Erkenntnis: beim Bandbreitenverhältnis hat es noch mal klick gemacht :)

Auch von mir herzlichen Dank für den tollen und verständlich geschriebenen Einstieg ins Thema!

Viel hilft eben nicht immer viel! ;)