Graue Maschine, bunter Klang

Immer wieder entwickeln Programmierer im Alleingang Synthesizer, von denen sich die Großen auf dem Markt ruhig mal ein Scheibchen abschneiden könnten. Der Sches Diversion von Dmitry Sches ist eines dieser Instrumente, voll mit guten Ideen und Funktionen, mit ungewöhnlicher Architektur und eigenständigem Klang.

„I hate making graphics“. Diesen Satz liest man auf der About-Seite von Dmitry Sches, und man glaubt ihm das. Der militärgraue Diversion mit seinem blauen Guckloch und den Fadenkreuzen versprüht den Charme einer Torpedo-Zieleinrichtung. Unter der Oberfläche dagegen sieht es viel farbenfroher aus, dort findet man einen Mix verschiedenster Synthesearten: Wavetable, additiv, subtraktiv, granular, FM, RM, Sampling und Shaping/Distortion-Funktionen.

Systemvoraussetzungen und Eckdaten

Synthesizer Plug-in mit 64 Stimmen

Windows ab XP SP2, VST 2.4

Mac (OS: k.A.) VST, AU

leistungsstarke CPU

Überblick

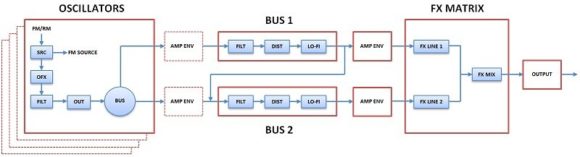

Der Diversion hat zwei identische Synthesestränge, die aus je zwei Oszillator-Filter-Driverblöcken bestehen und in zwei Stereo-Busse geroutet werden, in denen sich wiederum je ein Filter plus Driver und LoFi-Sektion finden. Jeder Bus läuft in eigene FX-Slots und beide münden zusammengemischt in eine weitere Effektabteilung. Dazu gibt es Arpeggiator/Gater und reichlich Modulatoren, vier LFOs und acht Hüllkurven.

Was ich mir grundsätzlich wünschen würde hinsichtlich der GUI:

Virtuelle Fader statt virtuelle Potis.

Ist im Handling mit der Maus wesentlich natürlicher und man sieht den aktuellen Status/Wert auch deutlich besser.

Mich halten durchweg unübersichtliche Oberflächen (u.a.) von der Nutzung von SW-Synths ab.

Schlechte Kontraste, unübersichtliche Anordnung, keine Skalierbarkeit des Fensters und und und.

Dieses Exemplar hier ist ja geradezu ein Paradebeispiel…..

Schade eigentlich, denn der Sound ist ja wirklich gut.

Ja die Augen macht man besser zu ;-) in punkto Fader stimme ich dir zu, Drehknopfemulationen sind eh ein Relikt aus der Hardwarezeit.

Das dürfte sich aber allgemein in der nächsten Zeit ändern, weil die Touchscreenbedienung durch die Tablet-PCs vorangetrieben wird. Irgendwann merken das auch die Hersteller ;-)

Hallo Holger,

also ich hab mir die Demoversion mal geladen und auspropiert auf meinem Testsystem. Die Prozessorlast auf einem Mac i3 8GB Ram bei einem Padakkord erzeugt wird ist heftig. Fraglich ob das Sinn, macht, mir ist es nicht gelungen einen Akkord ohne Aussetzer in Logic 9 zu bekommen.

Selbst im Standalone Modus mit VST AU Wrapper/Host betrieben,geht die Last nicht wirklich runter,erst beim Abschalten von FX und Co. kann man mit dem nackten Klang polyphon spielen.

Das wird in der Praxis allerdings niemand machen, i.d.R. kommt so ein Ding in Koop mit der DAW daher.

Die Oberfläche, freundlichformuliert, in einer nicht ganz hellen Arbeitsumgebung, macht die Farbgebung mit Tönen von Grau und Orange mit dem Blauen Blickfangpunkt mittwärts, bekloppt. Spätestens nach 45 Minuten wartet man auf ein rotes Blinken aus dem Lochblech über dem blauen Auge und eine nette Frauenstimme…

Ob nun Slider anstelle von Drehreglern besser sind auf einem Nichttouchrechner sei dahingestellt, wenn die Regler hier Anstelle der konstrastarmen Vertiefung, eine Kontrastierende Erhöhung gehabt hätten, wären die Regler leichter zu identifizieren.

Auf Touchsystemen machen Drehregler IMHO null Sinn oder ich baue wenigstens einen Overlay Schieberegler zum Drehregler.

Zum Klang, da gibts nichts zu meckern.

ToB

@TobyB Nochmal zum Thema Drehregler.

Das unnatürliche ist doch, dass ich, um den virtuellen Drehregler zu betätigen, ich die Maus entweder vertikal oder horizontal (da will ja auch jeder seinen eigenen „Standard“ durchsetzen) _gerade_ bewege.

Genau das halte ich für schlicht bescheuert.

Mal abgesehen, dass der Fangpunkt, wo ich den Regler abhole auch bei jeder zweiten GUI unterschiedlich liegt. Ergonomisch geht anders.

Virtueller Fader = Ich klicke die Faderkappe an und ziehe hoch oder runter = Gleiche Bewegung mit der Maus wie auf dem Bildschirm.

Wie bereits geschrieben: Schon dieses Detail macht mir einen SW-Synth so gut wie unbedienbar.

Oder den circular-Modus benutzen… gruselig! ;-) Wenn ich einen Synth viel einsetze, bastele ich mir ein Preset für einen meiner USB-Controller, das verbessert den workflow, hat natürlich aber wieder andere Nachteile. Genial in dieser Hinsicht ist zB das Arturia Minilab mit dem relative-Modus, auch bei Preset- und Instrumentwechsel hat man keine Parametersprünge. Das funzt leider nur mit wenigen Softsynths außerhalb des Arturia-Imperiums… Wäre schön, wenn sich das als Standard durchsetzen würde!

Hallo Andreas,

ganz gruselig ist drehen auf dem Trackpad :-D mein Kotau war und ist immer noch die Tempoeingabe bei iKorg iMS20 und iPolysix, beschleunigter Drehregler. Alle anderen Bedienelemente haben einen automatisierbaren Schiebeoverlay…. Das ist bitter ;-)

@TobyB Ja manche Sounds bringen auch schnelle Rechner in den roten Bereich. Abhilfe: Oversampling runterzuschrauben, Stimmenzahl minimieren, ggf nicht verwendete Module abschalten und evtl externe Effekte verwenden. Für den Test musste ich ein oder zwei Presets auch erst „spielbar“ machen…

@h.gerdes Hallo Holger,

das macht das kompliziert ;-) ich habe ein sehr komplexes Outboard ;-) ich musste mir angewöhnen mit roten, gelben, blauen Farben zu arbeiten, damit ich den CV, Midi und Audioweg überhaupt noch überblicke.

ToB

@h.gerdes …wobei ein i3 nun wirklich der kleinste Prozessor der i-Serie ist, im Vergleich zu I5 oder i7 fühlt sich das an, wie früher auf einem Celeron.

@vssmnn Nun ja, egal, ob das der kleinste der Prozessorfamilie ist oder nicht: Ein einziger SW-Synth, der eine Quad-CPU in die Knie zwingt hat definitiv Optimierungsbedarf.

Auch Mobiltelefone haben Quadcores, von denen erwarte ich, sobald es Richtung Musikerzeugung geht, nicht viel. Ist I3 nicht nur Dual-Core mit Hyperthreading, was jetzt nicht so viel zusätzlich bringt?

@Filterspiel a) Nein, die i-Serie sind keine Dualcores mit Hyperthreading.

b) Äpfel mit Birnen vergleichen ist ja OK, Desktop-CPUs mit LV-CPUs geht aber gar nicht.

Wie bereits geschrieben: Ein einziger SW-Synth, der den Rechner zur Vollast treibt (ohne weitere PlugIns einzubinden oder abstruse Effektwege zu schalten) ist programmiertechnsich einfach nicht akzeptabel.

Wenn wir erstmal wieder soweit sind, einen halbwegs aktuellen Rechner pro SW-Synth hinzustellen, können wir gleich bei HW-Synths bleiben.

Intel sagt I3 sind 2 Kern mit Hyperthreading, die sich als 4 Kern im System darstellen.

http://www.....essor.html

@Filterspiel Oki, alles klar, hab hier in meinen Macs nur i7er :)

Was aber nichts an meiner Grundaussage ändert: Das sind nichtsdestotrotz potente CPUs, die hier von einer einzigen Applikation offensichtlich an die Grenzen getrieben werden.

@Filterspiel Hallo Filterspiel,

Unter MacOS X Maverick ist das nahezu Wurst, sieht man mal von dem optischen Schnick-Schnack ab, haben wir ein BSD Unix derivat, was schon das Optimum aus der Kiste rausholt, praktisch ist nicht der Prozessor das Nadelöhr sondern RAM, HDD und Grafikkarte, selbst auf einem Intel Core Duo läuft Maverick und Logic X. Was Andreas schreibt ist absolut zutreffend, ein Prozess der die Maschine auslutscht muss optimiert werden, da ich noch Lastreserven für andere Prozesse brauche, nur weil eine Software möchte das ich aufrüste tue ich das nicht ;-)

Die Prozessoren die du in Handies, etc findest, selbst ein A5,A6,A7, A8 bewegen sich in ganz anderen Kategorien und sind mit Ausnahme der A Reihe von Apple nie für Audio optimiert worden.

Selbst für VST, AU, AAX Entwickler gibts es IDEs,RADs und Codevalidierungs Tools, die Performanceschwächen aufzeigen und hier Qualitätssicherung ermöglichen.

Weil was fange ich nur mit einem Synth im Rechner an? Es hat nicht jeder mal eben einen Rechner über, aber 4 CPU Kerne und ein anständiges OS können die Last schon gescheit aufteilen, einfach mal nach Grand Central Dispatch suchen. Für Win OS gibts Microsofts Task Parallel Library der .NET Plattform. Funktioniert beides super, der Programmierer muss es nur einsetzen.

Ich hab mit einem i5 unter Reaper 64 BIt mit einem Diversion Plug um die 10% Auslastung

@vssmnn Hallo Vssmnn,

das es sich so anfühlt würde ich nicht meinen, mein i 3 mac ist etwas gepimmt, mit ssd und soviel RAM wie geht, das Maverick läuft stabil und selbst mit Logic X kann man arbeiten, klar fette Softsynths sind hier ein Nadelöhr. Aber das muss er ja nicht können, in dieser Konfiguration bekomme ich laut iStat die Kerne selten über 20 Prozent Auslastung. Eine Software die dir dermassen viel Grundlast auf einem System erzeugt, hat ein Performanceproblem und sollte optimiert werden. Es bringt dem Nutzer nichts, wenn der Klang passt, aber er für ein einigermaßen performantes Arbeiten, entweder ein neues System brauch oder diverse Schrauben drehen muss, da mit hier und da ein paar cent Rechnenpower zur Verfügung stehen.

Grüsse

@TobyB Ja der Diversion braucht noch etwas Optimierung. Es kommt aber darauf an, wieviele und welche Module man einsetzt etc, man kann auch durchaus sparsame Sounds basteln. Und fairerweise muss man auch sagen, er befindet sich in dieser Hinsicht in bester Gesellschaft mit einigen Softsynths der aktuellen Generation, wie zB U-He Tyrell… es ist das übliche Spielchen: Jeder Fortschritt in Sachen Prozessorpower wird von der neuesten Software sofort wieder aufgefressen. Die Rechner sind in den letzten 25 Jahren 1000mal schneller geworden, aber booten und laden dauert noch genauso lange!

@h.gerdes Hallo Holger,

man muss ja nicht immer booten, der tiefe Ruhezustand reicht. MacOS bootet auch nicht wirklich schneller als Windows, nur im Single User Mode ist MacOS nach 3 Sekunden an der Shell, nur nützt das nichts. Es gibt zwar für Windows Werkzeuge und „Expertentips“ die das Starten beschleunigen, aber die sind mit Vorsicht zu geniessen. Ich empfehle den Ruhezustand, falls das System während der Arbeit zickt, kann man immer noch neubooten. Bei der Gelegenheit kann man dann auch automatisch „produktiv“ gesetzte Updates einspielen „lassen“ und sich nen Kaffee holen.

Klar haben andere Softsynths auch Probleme, ich hab mir bei mit einigen Entwicklern den Mund fusselig und faserig geredet. Ich bilde mir ein das ja keiner in C++ zu Fuss programmiert. Selbst wenn, es gibt automatische Optimierungstools. Und mit XCode für MacOS z.b. kann man einiges performanter machen, als Beispiel.

Klang ist gut, allerdings scheinen die Oszillatoren etwas Probleme in sehr hohen Oktavelagen zu haben.

Ich finde die GUI gut benutzbar, einiges ist vorkonfiguriert wie Vibrato so spart man sich irgendwelches geroute und man kommt schnell ans Ziel.

Anscheinend kein Multi-Thread Support, das ist eigentlich bei solchen Resourcenfressern ein muss. Bei kritischen Patches, also Unison mit sehr langen Releasezeiten, geht die Belastung der CPU schon ziemlich nach oben. Dafür das es keine aufwendige Emulation von irgendwelcher analogen Hardware ist, fragt man sich natürlich woher der CPU Verbrauch kommt? Da wurde anscheinend noch nicht viel optimiert.

Für das was er kann, wie er klingt, was er kostet und der Resourcenverbrauch finde ich den Diversion eher Befriedigend und wird bei mir sicherlich nicht im Plug-in Ordner landen.

Wer bei Diversion schon die Bedienung und das GUI kritisiert, möge sich mal den MPowerSynth ansehen.

OMG!