Was kann KI im Studio?

Inhaltsverzeichnis

Künstliche Intelligenz – das ist eins der Hauptthemen unserer Zeit und der Zukunft. Um sie ranken sich schon jetzt Legenden, Ängste, Sorgen und Hoffnungen. Die einen wähnen uns vor der Auslöschung und halten Terminator für eine Prophezeiung, andere wiederum sehen in ihnen die heilbringende Technologie, um mit ihr ein paar der größten, menschlichen Probleme Herr zu werden. Diese beiden Extreme findet man schnell, wenn man sich in den sozialen Netzwerken umsieht. Doch wie sieht die Wirklichkeit aus? 21 ist immer nur die halbe Wahrheit! Künstliche Intelligenz kann uns das Leben wirklich erleichtern, wenn wir die Kontrolle darüber behalten. Und inwiefern eine Intelligenz überhaupt künstlich erzeugt werden kann, weil ja die Basis einer autonomen, lernfähigen Software immer humanoiden Ursprungs ist und auf Grundlage mathematischer Prinzipien basiert, ist eine geradezu philosophische Frage. Aber darum geht’s hier auch gar nicht, diese Diskussionen überlasse ich gern den (Stammtisch-) Philosophen. Ich möchte wissen, wie und in welchem Umfang uns die KI im Tonstudio zur Hand gehen kann und ob wir davon profitieren können.

KI im Studio: Was erwartet uns?

Wie sieht denn so eine KI im Tonstudio nun genau aus? Da sitzt ja jetzt kein Alien im Chefsessel und dreht an irgendwelchen Reglern, bis es gut klingt. Nach wie vor müssen wir schon unsere Instrumente noch selbst spielen, auch wenn es bereits erste Clips im Netz gibt, in der eine KI Songs komponiert und produziert. Die Ergebnisse reichen von äußerst mittelmäßigem Schlager, bis zur besorgniserregend guten Vollendung der Unvollendeten. Aber zeichnet sich KI nicht grundsätzlich dadurch aus, dass sie lernfähig ist und dementsprechend aus Fehlern und Misserfolgen lernt?

Ganz genau, das tut sie! Und jetzt wird’s interessant. Wenn doch immer wiederkehrende Abläufe, die ein gewisses Muster erkennen lassen, in unserer Arbeitsroutine verborgen sind, warum sollten wir uns dann nicht eine KI zu Hilfe nehmen, die unsere Abläufe und Vorlieben lernt und uns dienstbar zur Seite steht? Es geht ja nicht darum, einer KI im Studio blindlings zu vertrauen. Es geht vielmehr darum, Vorschläge anzunehmen, zu überprüfen und – und da kommt jetzt der Mensch ins Spiel – zu bewerten, einem subjektiven Urteil zu unterziehen. Die letzte Instanz sollte aus künstlerischer Sicht immer der Mensch sein. Sonst siegt tatsächlich die Maschinenwelt und Terminatoren werden uns jagen und Wall-E wird die Reste der Welt aufräumen, während fette Raumschiffskommandanten in selbstfahrenden Sesseln entscheiden, welcher Planet zukünftig der Beste für uns sein könnte. Das können wir nicht wollen.

KI im Studio: Was kann sie leisten?

Also die gute Nachricht: Es braucht immer noch Menschen im Studio. Menschen mit guten Ideen, mit Visionen. Menschen, die den Maschinen sagen, was die Menschen von den Maschinen wollen. Es spricht aber sicherlich nichts dagegen, eine KI im Studio einzusetzen, die uns einzelne Schritte abnimmt. Würden wir neuen Technologien nicht immer mal eine Chance geben, würden wir heute noch unser Feuerholz zu Fuß in die Lehmhütte tragen und dem Knistern des Feuers lauschen, statt in satten Klängen aus einer 7.000,- Euro teuren Stereoanlage zu schwelgen. Welche Bereiche kann aber die KI nun übernehmen? Am einfachsten dürfte es sein, der KI Routineaufgaben zuzuweisen. Dazu gehört auch, die Schallereignisse, die auf dem virtuellen Band aufgezeichnet wurden, zu analysieren und zu formen. Jeder Produzent hat so seine Eigenheiten. Der eine schwört auf einen fetten Bass, der andere räumt gerade im Bassbereich extrem auf und lässt der Psychoakustik Raum und dem Ohr die Freiheit, Lücken zu füllen.

Die Firma Sonible hat mir für diesen Workshop ein paar ihrer KI-basierten Plug-ins zur Verfügung gestellt, mit denen ich mich als Gelegenheits-Recorder im Heimstudio nun auseinandersetzen darf. Die Ergebnisse dürften aber durchaus auf große Studios übertragbar sein. In einem kurzen Gespräch mit Ossy Pfeiffer von Osmator bringt der es auf den Punkt: „Ich finde es gut, dass es solche Tools gibt, die erleichtern uns, die ja im Musikgeschäft professionell arbeiten und Durchblick haben, den Arbeitstag. […] Das wird sehr hilfreich sein und du wirst damit schneller Brot & Butter Dinge erledigen können, dafür sind KI-Sachen total cool.“ Und weitergehend wird er ein wenig philosophisch und nachdenklich, als er einwirft: „Ich finde die Entwicklung (der KI, Anm. d. Red.) prinzipiell schon erschreckend und es macht mir auch Angst, aber es gibt ja für uns Musiker und Musikerinnen ja nur zwei Möglichkeiten: Entweder du verweigerst dich der Entwicklung komplett, dann findest du aber nicht statt, dann bist du raus aus dem Geschäft, denn das Zeug entwickelt sich ja auch weiter. Oder du nimmst dich der Sache an und guckst, was es auf dem Markt gibt und wie kann ich das in meinen Workflow einbinden und wie kann mir das helfen, dass ich meine Arbeit schneller erledigen kann und dementsprechend auch Geld verdienen kann.“

Und genau dieser „Brot & Butter-Satz“ hat es mir angetan. Wenn ich der KI im Studio sage, wie sie mir dienstbar zur Hand gehen kann, erspare ich mir eine ganze Handvoll zeitaufwändiger Schritte, die im Studio letztlich Zeit, Geld und Nerven kosten. Und dabei geht es gar nicht darum, der KI das Feld zu überlassen. Die letzte Entscheidung, ob das Ergebnis gut ist, tragen der ausführende Produzent und der Künstler. Nehmen wir das Beispiel des Equalizing. Habe ich ein Signal, das bereits nach allen Regeln der Kunst aufgenommen wurde – denn nach wie vor gilt, dass auch eine KI ein schlechtes Signal nicht einfach in ein gutes Signal verwandeln kann – benötige ich möglicherweise gar keinen Equalizer mehr. Wer denkt, mit Einsatz einer KI mal eben einem erfahrenen Produzenten das Wasser abgraben zu können, wird zwangsläufig auf die Nase fallen. Nein, es geht vielmehr um die Nuancen im Signal, die zum Beispiel mit anderen Signalen interferieren oder kleine Spitzen, die zum Beispiel eine wundervoll gespielte Gitarre an einigen Stellen zu laut erscheinen lassen. Hier kann ich mich auf die Suche begeben, die Frequenz analysieren, die da stört und dann gezielt eingreifen; oder ich drücke den „Learn“-Button und lasse die KI eine erste Korrektur vornehmen und kann mich im Weiteren um das große Ganze kümmern.

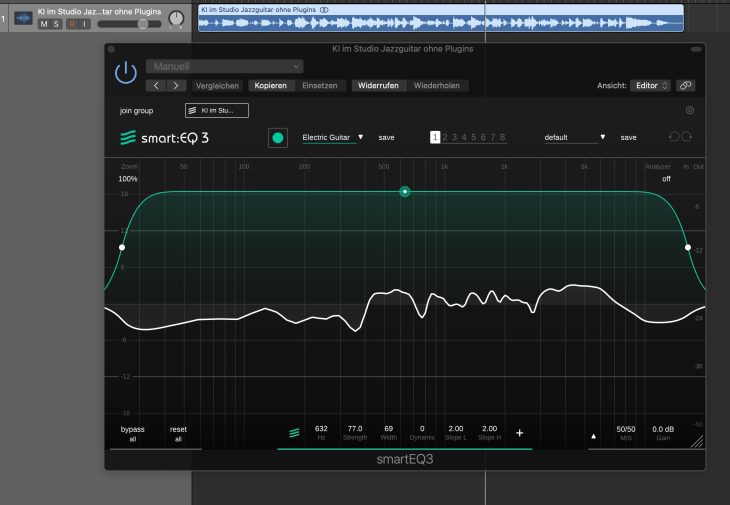

KI im Studio: Der Sonible Smart:EQ 3

Hören wir mal, was der Smart:EQ von Sonible so draufhat. Das Ausgangssignal ist eine Gitarre (ja, sorry, ich bin Gitarrist …) mit leicht jazzigem Touch, zum Einsatz kommt eine Sire Guitars Larry Carlton, die ich gerade zum Test für die Gitarrenredaktion hier habe. Der Sound kommt aus meinem Kemper und ist das Profile eines Dumble Amps. Vor allem am Ende des Files fällt die Basslastigkeit auf, eine Frequenz, die man mit einem herkömmlichen EQ-Plug-in suchen und absenken muss. Was mich aber viel mehr interessiert, ist die Frage, wie der Smart:EQ sich den Gesamtsound vorstellt. Ihr hört zunächst das pure Audiofile, ohne Plug-in. Für das zweite Beispiel habe ich dem Smart:EQ zu verstehen gegeben, dass er ein E-Gitarrensignal zu bearbeiten hat. Der Eingriff in die Frequenzen ist subtil, aber umfassend, wie der Screenshot zeigt. Das Ergebnis ist ein schlankerer Sound, der aufgeräumter wirkt.

KI im Studio: Der Sonible Smart:Comp 2

Jetzt kommt der Kompressor ins Spiel. Als Ausgangsfile dient wieder die Jazzgitarre, der Smart:EQ bleibt im Signalweg. Auch hier ist das Ergebnis unglaublich schnell sehr gut und auch für nicht so geübte, aber motivierte Newbies leicht erreichbar, auch wenn ein gewisses „Pumpen“ im Sound vernehmbar ist. Aber auch hier gilt: Die KI ist ein Gehilfe, nicht der Chef! Keiner zwingt mich, ein Ergebnis als supidupigut zu akzeptieren. Eingreifen kann ich immer, ich bin und bleibe die letzte Instanz.

Der Screenshot zeigt wieder, wo der Kompressor genau ins Geschehen eingreift. Bei all diesen Beispielen sei nochmals erwähnt, dass ich kein Studioprofi bin.

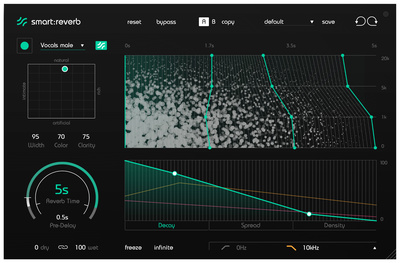

KI im Studio: Das Sonible Smart:Reverb

Jetzt wird’s komplexer. Ossy hat mir freundlicherweise ein professionell aufgenommenes Drumset zur Verfügung gestellt. 12 Drumspuren eines kompletten Songs erreichen mich, Dropbox sei Dank. Ich importiere und sortiere. Im ersten File hört ihr einen Ausschnitt des trockenen Signals, ohne Verwendung etwaiger Plug-ins. Der Mix der einzelnen Spuren ist so Pi mal Daumen, also so, wie ich das beim ersten Hören gut finden würde. Normalerweise würde man jetzt nicht auf den Gedanken kommen, da einfach Hall draufzulegen, oder? Also klar, auf die Snare darf ein gated Reverb, die Toms haben eigentlich durch die Raummikros genug Ambience. Also knallen wir testweise einfach mal das Smart:Reverb in die Summe. Und siehe da, wir haben Raum, der das Signal nicht ertränkt, irgendwie steht das Drumset gefühlt gerade in der Sporthalle der IGS Untermöhringen und der Seppl drischt auf die Felle, als ob’s kein Morgen gäbe. Wohl gemerkt, ich habe nichts gemacht, außer den „Learn Button“ zu drücken. Der Screenshot zeigt die Hallfahne grafisch an. Natürlich kann ich auch hier immer eingreifen, ändern, wegwerfen. Aber für meinen Geschmack hat dieses Plug-in schon gut getroffen.

KI im Studio: Das Sonible Smart:Gate

Kümmern wir uns mal nur um die Snare, die wurde mit zwei Mikros aufgenommen, eins Top und eins Bottom. Ihr hört im ersten File die beiden Spuren zusammen ohne Bearbeitung, also inklusive der Übersprechungen des restlichen Drumsets. Das zweite File demonstriert das Smart:Gate in Verbindung mit dem Smart:Reverb. Die Snare gewinnt deutlich an Kraft.

Jetzt wird’s wild! Ich bearbeite jede Spur des Drumsets mit den KI-Plug-ins Smart:Gate, Smart:EQ und Smart:Reverb, je nach Bedarf und außer der schon bei der Aufnahme gegateten Kick-Spur und den Overheads. Ich finde, das Ergebnis kann sich hören lassen.

Eine weitere, höchste interessante Anwendung des Smart:Gate ist übrigens, Kick und Snare aus einem bestehenden Drumloop herauszufiltern, um diese dann einzeln weiter zu bearbeiten. Da stoßen herkömmliche Gates schnell an die Grenze. Um einen bestehenden Beat in seine Bestandteile zu zerlegen, müsste aufwändig geschnitten werden. Ich nehme das Drumkit und sage dem Smart:Gate, es soll bitte die Kick separieren. Anschließend wird diese einzeln (und in diesem Falle zwecks Demonstration extrem übertrieben) bearbeitet und dem Original wieder hinzugefügt. Das ist schon krass, mit wie wenig Aufwand hier große Veränderungen vorgenommen werden können. Ganz so gut wie im Werbevideo funktioniert das mit einem natürlichen Drumset mit fiesen Übersprechungen natürlich nicht, aber die Möglichkeiten sind enorm.

Sie sehen gerade einen Platzhalterinhalt von Youtube. Um auf den eigentlichen Inhalt zuzugreifen, klicken Sie auf die Schaltfläche unten. Bitte beachten Sie, dass dabei Daten an Drittanbieter weitergegeben werden.

Hm – irgendjemand hat im Gegensatz zum Autor die Bewertung „Finger weg” gegeben, ohne einen Kommentar hier zu setzen. Ich bin etwas ratlos, nicht weil ich Interesse an solchen Plugins hätte, dafür liebe ich meine zugegebenermaßen laienhafte Herangehensweise bei Studioaufnahmen zu sehr.

Aber es interessiert mich grundsätzlich, welchen Hintergrund solch sehr unterschiedlichen Bewertungen haben.

@Jan: Vielen Dank für deinen aufschlussreichen und interessanten Artikel – … oder war da doch eine KI am Werk?? 😜

@herw Den hab ich ganz allein geschreibt 😝

Solche Bewertungen sind natürlich immer streng subjektiv. Ein Chris Lord Alge würde solche Plugins wahrscheinlich behandeln, wie der Papst ein Kondom.

@Jan Steiger Hallo Jan, ich kann Deinem Fazit nur beipflichten. Arbeite schon länger mit Sonible (EQ und Comp) sowie Gullfoss und Soothe und kann aus meiner Erfahrung nur sagen, dass die Dinger für mich als Musiker/Produzent mit langer Tontechnik-Erfahrung sehr hilfreich sind, v.a. wenn es schnell gehen muss und/oder man eben kein CLA ist. Darüber hinaus kann man dabei auch noch etwas lernen …

@herw Im Kunstbereich macht folgende Aussage die Runde:

KI ist industrialisiertes Raubkopieren.

Das kann ich gut nachvollziehen, wenn ich bedenke, wo (vermutlich) die Trainingsdaten für die KI herkamen. Vielleicht will derjenige mit der Bewertung »Finger weg« das damit zum Ausdruck bringen.

@Flowwater der begriff „raubkopie“ ist ein oxymoron, und die verwendung desselben gilt als polemisch….und was ist bitte der „kunstbereich“?

@dilux Kunstbereich: Alles was mit Kunst zu tun hat

Raubkopie: Sogar der Duden weiß, wie man das Wort benutzt

@Flowwater der duden bewertet begriffe nicht, ich schon….raubkopie ist ein kunstwort, das die contentindustrie erfunden hat, um einen – an sich – legalen vorgang illegal erscheinen zu lassen; siehe auch „home taping is killing music – its illegal“ mit dem man schon in den 80ern in die kriminelle ecke verschoben werden sollte.

@dilux Vielleicht wird „Raubkopie“ einfach auch nur von denen verwendet, denen „urheberrechtswidrig vertriebene Kopie“ zu sehr nach „Kleiderbügel noch im Hemd“ klingt.

Urheberrecht gab es in den 80igern schon, entsprechende Verstöße dagegen auch. Musste also nicht zwangsläufig alles in die „illegale Ecke“ verschoben werden (einiges hatte sich durchaus schon dort befunden).

@m-ex nein, es ist doch eher so, wie ich es geschrieben habe…

@dilux OK, Ich nicht.

@dilux Also wenn jemand meine Songs auf CD brennt, ein notdürftiges Cover kopiert und das alles um den halben Preis verkauft, den ich verlange, dann sehe ich das durchaus als Raub meines Eigentums – und nicht nur des geistigen

@dr noetigenfallz Kurz mal den Klugscheißer-Modus an:

Da Dir dabei weder Gewalt zugeführt noch angedroht wurde, müsste es eher „Diebstahlkopie“ heissen.

-OFF-

Ansonsten stimme ich Dir gerne zu, dass der Begriff der „legalen Privatkopie“ vielerorts doch ganz gerne mal etwas strapaziert wird.

Kann mir glücklicherweise aber auch egal sein, da ich in Musik nebst ensprechendem Equipment lediglich Geld investiere anstatt davon leben zu müssen.

@Flowwater Was, wenn mit royalty free AAA-Material trainiert wurde, nur das hier nicht die Samples im Endprodukt Verwendung finden, sondern deren tontechnische Bearbeitung? Hier geht es mMn. um Werkzeuge, die in der Kunst angewendet werden, nicht das Kunstwerk an sich.

KI-Melodiegeneratoren = komplett anderes Thema, keine Frage.

@Filterspiel Wenn Sonible das im Falle ihrer Tools gemacht haben, dann würde ich das sogar begrüßen. Aber bisher ist ja keine Firma, die sich »KI« auf die Fahne schreibt dazu gezwungen, die Quelle der Trainingsdaten offen zu legen. Von daher gehe ich mal eher vom Schlimmsten aus. Dass nämlich einfach alles an Songs genommen wurde, was greifbar war, und damit das Know-How von Mixing- und Mastering-Engineers hemmungslos an die KI verfüttert wurde.

Ausgehend von dieser Überlegung kann ich jeden verstehen, der sagt »Finger weg!«

@Flowwater Hmm, dann dürfte man ja auch keine reference tracks verwenden.

@E Ford Der Unterschied ist der menschliche Faktor.

Um das Ergebnis der „KI“ bewerten zu können, muss man schon genug Erfahrung haben, um dieses auch ohne KI hinzubekommen. Ich hätte zumindest bei jedem Schritt einen Vergleich erwartet. Für die „Alltagsarbeiten“ gibt es außerdem ja bereits Templates und andere Hilfen, dazu benötigt man keine AI. Wahrscheinlich macht das wirklich dann Sinn, wenn man möglichst Kopien von bestehenden Songs erstellen möchte, vom Arrangement bis zum Master. Im Übrigen, ohne einen direkten Vergleich zur „EI“-Vorgehensweise liest sich der Artikel für mich eher wie eine typische Influencerwerbung für die verwendete Software, insbesondere da es ja jede Menge Alternativen gibt, die nicht benannt werden. Der Titel wäre dann wohl besser “ WORKSHOP: SONIBLE PLUG-INS IM TONSTUDIO, SMARTE EQS UND INTELLIGENTE REVERBS 😎

Ich sehe KI/AI nicht sonderlich anders als Presets. Sie geben eine Startgrundlage und in seltenen Fällen passt es grad genau. Bei manchen Dingen klappt das besser als an anderer Stelle. Der o.g. Kompressor z.B. hinterlässt bei mir keine konstant guten Ergebnisse. Den Reverb kenne ich nicht. EQ benutze ich ausschließlich ohne Presets und verlasse mich auf mein Gehör. Da hat mich bisher noch keine KI überzeugen können (kann sich aber ja noch ändern).

wirklich sinnvoll an ki wäre, wenn „sie“ sich den antispetischen mist, den sie „kreiert“ hat, auch selber anhören müsste.

letztlich hat schon die rein auf simulation beruhende plug-in herangehensweise nur noch sehr bedingt mit musik machen zu tun, sowie mp3 nichts mit musik hören zu tun hat, ist aber auch vollkommen ok. jede generation bekommt das was sie verdient und die „jetzige“ trägt dazu bei und muss damit leben, dass es keine musikszene, keine konzerte etc mehr gibt, sondern im günstigsten fall halt höchstens instagram-selfie-events.

da passt die ki ganz gut rein, und am ende glauben die plug-in gerüsteten „laptop-studio-owner“ wirklich noch, sie wären kreativ gewesen und hätten „musik gemacht“. das ist doch super.

@noizepreacher „ und die „jetzige“ trägt dazu bei und muss damit leben, dass es keine musikszene, keine konzerte etc mehr gibt“

Aus welcher Zukunft schreibst Du? „Jetzt“, also heute, gibt es noch eine hervorragende Szene von jungen Musikern und auch jungen Hörern die Musik richtig geniessen können. Vielleicht ist das nicht im Kommerz-Firlefanz zu finden, aber wenn man sich ein bisschen umhört findet man wirklich tolle Sachen und eine ganz starke Szene

Ich nutze seit ein paar Monaten die sonible Plug Ins mit wachsender Begeisterung.

Sie erstellen Vorschläge, welche nach spezifischer Feinabstimmung oftmals überzeugend klingen. Und was will ich mehr – das Ergebnis muss passen.

Der smart:limit hat inzwischen den Fabfilter Pro – L2 im Stereo Out bei mir ersetzt. Ersterer überzeugt durch eine Zielmedien-spezifische Limitierung mit Feinabstimmung des Stils (soft / hart), der Sättigung ! und einer finale Bassanpassung. So hab ich mir das gewünscht.

Der smart:EQ3 hat es sogar in die Summe geschafft, da er hier das Geschehen akustisch aufräumt. Auf Wunsch macht er das sinnvoller weise dynamisch, was ich mit keiner auch noch so aufwändigen Automation hinbekommen würde.

Klar, der Mix sollte vorher schon stimmen. Wunder sind nicht zu erwarten. Die eigenen Ohren sind immer noch die Referenz. Und diese freuen sich bei mir über einen sanften KI Support.

Mir ist nicht ganz klar, was an den Sonible Sachen intelligent sein soll? Die PlugIns analysieren das Audiomaterial und man kann eine bestimmte Parametrierung auswählen, mit der auf das Material reagiert wird. Nicht falsch verstehen…ich will die PlugIns nicht abwerten, aber unter KI stelle ich mir schon noch was anderes vor.

@0dB Hier das offizielle Statement dazu: https://www.sonible.com/de/blog/sonible-plug-ins-kunstliche-intelligenz-im-einsatz/